| 失效链接处理 |

|

大模型(LLMs)强化学习—— PPO 面 PDF 下载

相关截图:

主要内容:

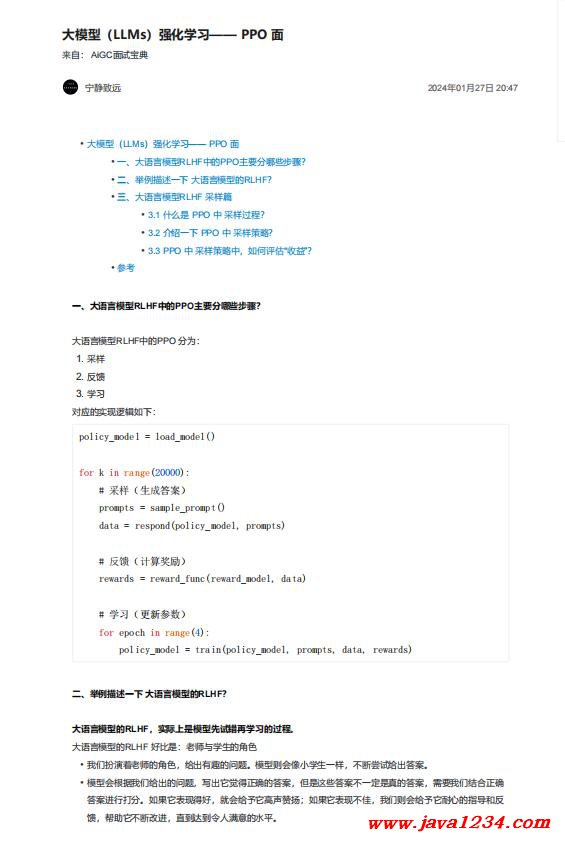

一、大语言模型RLHF中的PPO主要分哪些步骤?

大语言模型RLHF中的PPO 分为:

对应的实现逻辑如下:

二、举例描述一下 大语言模型的RLHF?

大语言模型的RLHF,实际上是模型先试错再学习的过程。

大语言模型的RLHF 好比是:老师与学生的角色

• 我们扮演着老师的角色,给出有趣的问题。模型则会像小学生一样,不断尝试给出答案。

• 模型会根据我们给出的问题,写出它觉得正确的答案,但是这些答案不一定是真的答案,需要我们结合正确

答案进行打分。如果它表现得好,就会给予它高声赞扬;如果它表现不佳,我们则会给予它耐心的指导和反

馈,帮助它不断改进,直到达到令人满意的水平。

|

苏公网安备 32061202001004号

苏公网安备 32061202001004号